AI繪畫領域的知名開發者、ControlNet的作者推出了一項備受矚目的新項目。盡管項目尚未開源,但已在GitHub上迅速斬獲660顆星,引發了技術社區的熱烈討論。這次突破的核心在于,AI繪畫工具首次實現了類似傳統數字藝術軟件的“圖層分離”功能,這標志著生成式AI在圖像處理與創作控制方面邁出了關鍵一步。

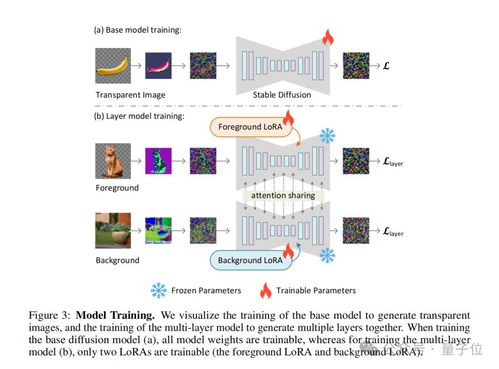

長久以來,基于擴散模型的AI繪畫工具(如Stable Diffusion)雖然能生成驚艷的圖像,但輸出結果通常是一個“扁平”的整體,用戶難以對生成圖像中的特定元素(如人物、背景、裝飾物)進行獨立編輯或調整。新項目通過創新的數據處理和模型架構,試圖解決這一痛點。據悉,該技術能夠在一定程度上解析并分離生成圖像中的不同語義組成部分,并將其對應到可獨立操作的“圖層”或“通道”中。這意味著用戶可以在AI生成初稿后,像使用Photoshop一樣,單獨修改畫面中某個對象的顏色、紋理、位置,甚至替換它,而無需重新生成整張圖像,極大提升了創作效率和可控性。

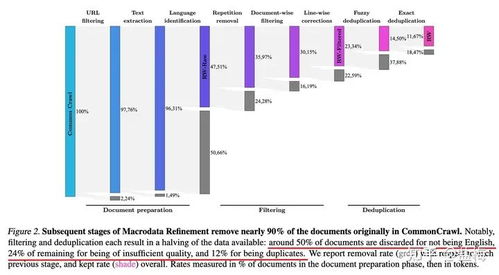

項目的火爆,其背后的數據處理方法論功不可沒。從已披露的信息看,這項工作并非簡單地給現有模型打補丁,而是在訓練數據的構建、標注以及模型的學習目標上進行了深度革新。研究者很可能構建了包含豐富圖層結構信息的配對數據集,并設計了相應的學習框架,使模型能夠理解并輸出分層的表征。這種對數據“結構”的重視和處理,正是當前AIGC從“粗放生成”走向“精細控制”的重要技術路徑。

660顆星在項目未開源的情況下獲得,充分反映了社區對更高控制力AI繪畫工具的迫切需求以及對該作者技術信譽的認可。ControlNet的成功已經證明了其在引入空間條件控制方面的強大能力,而此次新作可被視為在“語義層”控制上的一次躍進。它預示著未來AI繪畫的工作流程將與專業設計軟件深度融合,藝術家可以更自然地將AI作為創意伙伴,進行迭代式、非破壞性的編輯。

項目仍處于早期階段,其實際效果、泛化能力以及開源后的具體實現細節還有待觀察。但毋庸置疑,它已經為AI繪畫的數據處理與模型設計方向點燃了一盞明燈。當AI不僅能生成像素,還能理解并輸出像素背后的結構時,一個更強大、更協作的數字創作新時代正在悄然來臨。